Σύμφωνα με το σενάριο της κινηματογραφικής ταινίας «Transcendence (2014)», ο πρωταγωνιστής (Johnny Depp) – κορυφαίος επιστήμονας τεχνητής νοημοσύνης (ΤΝ) -, τραυματίζεται θανάσιμα. Όμως, η σύζυγός του με τον στενότερο συνεργάτη του προλαβαίνουν να μεταβιβάσουν με επιτυχία την συνείδησή του σε έναν κβαντικό υπερ-υπολογιστή. Πολύ γρήγορα το σύστημα ξεπερνά το κρίσιμο σημείο που ονομάζεται τεχνολογική ιδιομορφία ή μοναδικότητα (singularity) ή transcendence όπως αποκαλείται στην ταινία και αποκτά ικανότητες ανώτερες του ανθρώπινου εγκεφάλου απειλώντας να κατακτήσει τον κόσμο ολόκληρο. Η τεχνολογική ιδιομορφία θεωρείται ως ένας διανοητικός ορίζοντας γεγονότων πέραν του οποίου τα συμβάντα δεν θα μπορούν να προβλεφθούν ή να κατανοηθούν από τους ανθρώπους. Σύμφωνα με τους ειδήμονες η εκδήλωσή της αργεί – κάποιοι την τοποθετούν αρκετά μετά το 2050. Κάποιοι δηλώνουν ευθαρσώς ότι δεν πρόκειται να επιτευχθεί ποτέ, θεωρώντας ότι όποιος ισχυρίζεται το αντίθετο τέτοιο λέει ανοησίες. Αλλά η ιστορία μας διδάσκει «ότι η ιστορία δεν διδάσκει».

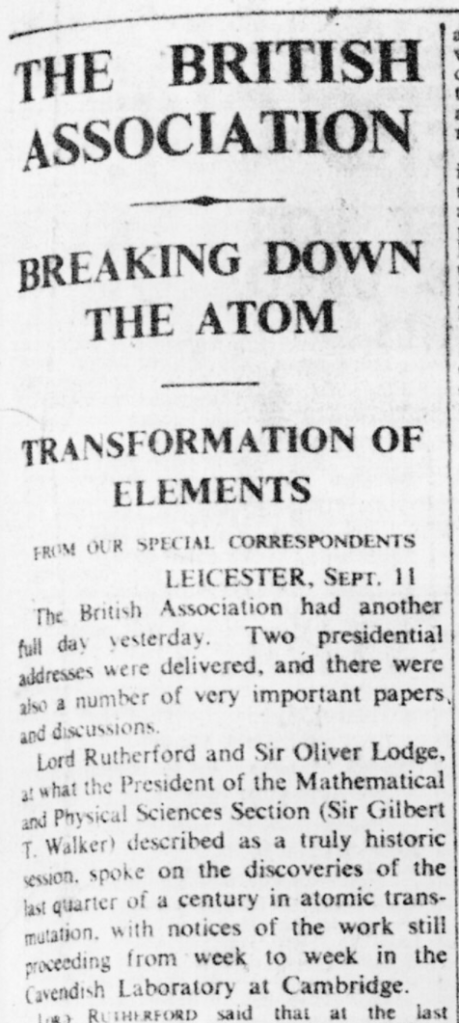

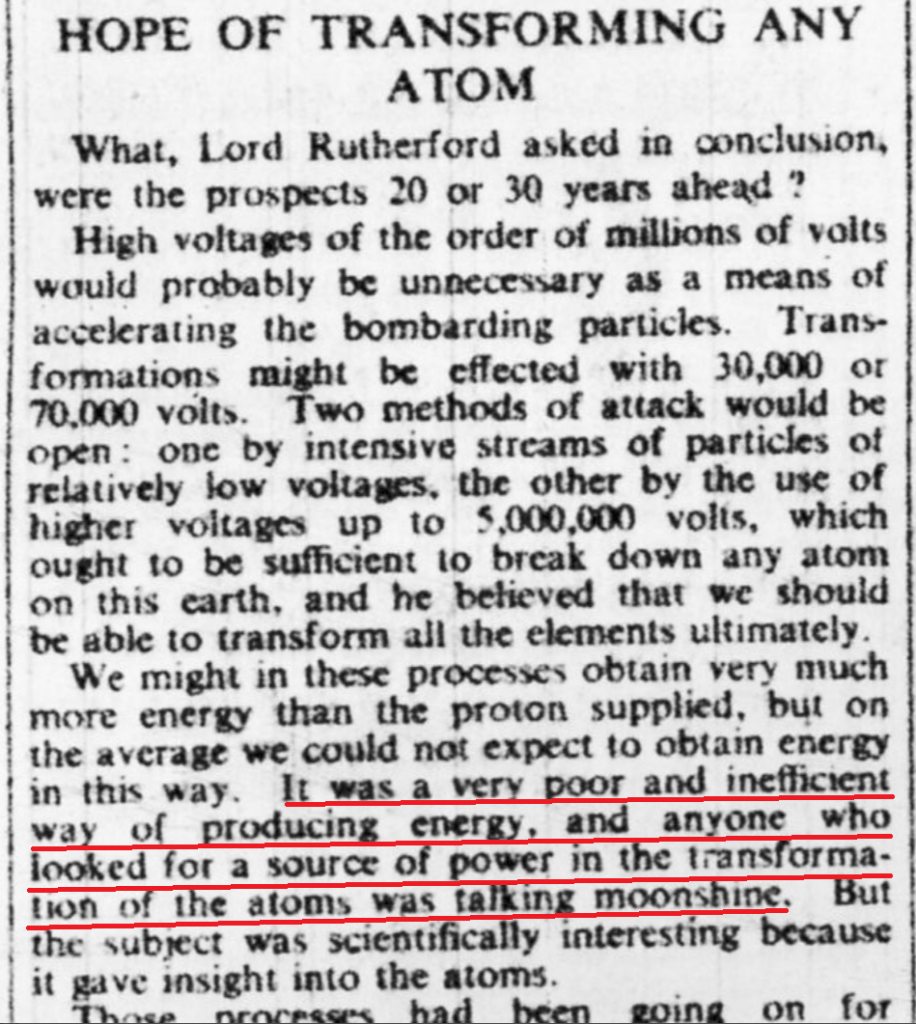

Πριν από περίπου έναν αιώνα, ο πατέρας της πυρηνικής φυσικής Ernest Rutherford, διακατεχόταν από μια αντίστοιχη πλάνη. Πίστευε πως η ιδέα της αξιοποίησης της πυρηνικής ενέργειας δεν είναι παρά μια ανοησία!

Σύμφωνα με το φύλλο της 11ης Σεπτεμβρίου του 1933 των Times του Λονδίνου, έδωσε μια διάλεξη στο Λέστερ σχετικά με τον μετασχηματισμό των στοιχείων. Στην ομιλία του ο Rutherford αναφέρθηκε και στην εργασία των John Cockcroft και Ernest Walton σχετικά με την διάσπαση του λιθίου σε σωματίδια άλφα μετά από βομβαρδισμό με πρωτόνια στον επιταχυντή σωματιδίων που είχαν κατασκευάσει. Ο Rutherford αναγνώρισε ότι η ενέργεια που απελευθερώνεται σ’ αυτή τη διαδικασία ήταν μεν τεράστια, αλλά θεωρούσε ότι ήταν αδύνατον να εκμεταλλευτούμε αυτή την ενέργεια, δηλώνοντας ότι: «πρόκειται για έναν πολύ φτωχό και αναποτελεσματικό τρόπο παραγωγής ενέργειας και όποιος ψάχνει για μια πηγή ενέργειας στην διάσπαση των ατόμων λέει ανοησίες» .

Ο Leo Szilard, ένας Ούγγρος φυσικός που είχε διαφύγει στο Λονδίνο όταν ο Χίτλερ έγινε καγκελάριος της Γερμανίας, διαβάζοντας το παραπάνω άρθρο των Times – χωρίς να επηρεαστεί από το επιστημονικό κύρος του Rutherford – εμπνεύστηκε την αλυσιδωτή πυρηνική αντίδραση με νετρόνια, τα οποία είχαν ανακαλυφθεί το 1932. Ο Szilard υπέβαλε αίτηση για το σχετικό δίπλωμα ευρεσιτεχνίας, το οποίο του χορηγήθηκε το 1936. Και κάπως έτσι ξεκίνησαν οι πυρηνικές βόμβες, αλλά και τα πυρηνικά εργοστάσια παραγωγής ενέργειας, που δεν περνούσαν από το μυαλό της επιστημονικής αυθεντίας του Rutherfond.

Το ηθικό δίδαγμα της ιστορίας: είναι μάλλον επικίνδυνο και απερίσκεπτο να ποντάρει κανείς κατά της ανθρώπινης εφευρετικότητας, ιδίως όταν αυτό που διακυβεύεται είναι το μέλλον μας. Σύμφωνα με τον Stuart Russell, στην κοινότητα της Τεχνητής Νοημοσύνης (ΤΝ), διαφαίνεται ένα είδος άρνησης, η οποία φτάνει μάλιστα στο σημείο να αρνείται το ενδεχόμενο να επιτευχθεί μακροπρόθεσμα το κρίσιμο σημείο της τεχνολογικής ιδιομορφίας. Είναι σαν ένας οδηγός λεωφορείου με επιβάτες όλη την ανθρωπότητα να λέει, «Ναι, οδηγώ όσο πιο γρήγορα μπορώ προς τον γκρεμό, αλλά πιστέψτε με, θα μείνουμε από καύσιμα πριν φτάσουμε εκεί!»

Η Τεχνητή Νοημοσύνη και το πρόβλημα του ελέγχου

Σχετικά με το βιβλίο του Stuart Russell, «Συμβατή με τον άνθρωπο;» : Βιώνουμε μια τεχνολογική επανάσταση που εγείρει βαθιά ερωτήματα για το τι είναι «άνθρωπος». Το σώμα και το μυαλό μας, που κάποτε τα θεωρούσαμε αποκλειστικά δικά μας, σύντομα θα αποτελούν εκφάνσεις μιας νοημοσύνης που δεν θα είναι ούτε φυσική ούτε τεχνητή. Πόσο συμβατή με τον άνθρωπο θα είναι μια μηχανή με νοημοσύνη ανώτερη από τη δική του; Θα συνυπάρξουμε ή μήπως, κάτω από την εξουσία της, θα καταρρεύσουν οι θέσεις εργασίας, οι ανθρώπινες σχέσεις, και ο ίδιος ο πολιτισμός μας; Ποιος, τελικά, θα κατέχει το «είναι» μας και τα δεδομένα του;

Ο Στιούαρτ Ράσελ –κορυφαίος επιστήμονας της Τεχνητής Νοημοσύνης, η «φωνή» της κατά κυριολεξία–περιγράφει πώς, μπροστά σε ένα μέλλον που έρχεται νωρίτερα απ’ όσο νομίζουμε, θα καταφέρουμε να αλλάξουμε πορεία προτού να είναι αργά. Προδιαγράφει τρόπους σχεδιασμού συστημάτων Τεχνητής Νοημοσύνης ασφαλών και ωφέλιμων για τον άνθρωπο. Προτείνει μηχανές που θα τις χαρακτηρίζει η αβεβαιότητα (η αμφιβολία) ως προς τους στόχους τους –στοιχείο θετικό, όχι σφάλμα της λειτουργίας τους– με επακόλουθο να συμμορφώνονται με τις επιθυμίες των ανθρώπων: θα ζητούν την άδειά τους, θα αποδέχονται διορθώσεις, θα τίθενται εκτός λειτουργίας, θα είναι ταπεινές, αλτρουιστικές, θα ανακαλύπτουν νέες δράσεις και, όπως κι εμείς, θα διαχειρίζονται τις γνώσεις τους και θα αποφασίζουν γρήγορα. Θέτει το πλαίσιο ελέγχου της Τεχνητής Νοημοσύνης, με πρωταρχικό μέλημα ότι οι πράξεις των μηχανών θα οδηγούν στην επίτευξη των δικών μας στόχων, όχι των δικών τους. Ο Ράσελ θεωρεί την υπερανθρώπινη Τεχνητή Νοημοσύνη ως υπαρξιακή απειλή για το είδος μας και παράλληλα την αναγνωρίζει ως το ύψιστο επίτευγμα του ανθρώπου. Ας ευχηθούμε ότι δεν θα είναι και το ύστατο.

Συχνά, και όχι αδίκως, η Τεχνητή Νοημοσύνη μάς τρομάζει. Μολονότι προσφέρει τεράστιες δυνατότητες για βελτίωση της ζωής μας, δεν παύει να είναι μια εργασιακή επανάσταση πολύ διαφορετική από τις προηγούμενες, που μεταμορφώνει ολόκληρο το σύστημα παραγωγής, μετασχηματίζει τη δομή της διακυβέρνησης, και ανατρέπει τη σύγχρονη πολιτικοκοινωνική τάξη πραγμάτων. Στις μέρες μας επενδύονται δισεκατομμύρια σε μια παγκόσμια προσπάθεια να «ξεκλειδωθούν» τα οφέλη της Τεχνητής Νοημοσύνης –τόσο στην καθημερινή ζωή όσο και στους κρατικούς μηχανισμούς και τις επιχειρήσεις– με στόχο το πέρασμα της κοινότητας προς ένα βιώσιμο, ακόμη πιο συναρπαστικό μέλλον. Παράλληλα, η έρευνα για την προσέγγιση της υπερανθρώπινης Τεχνητής Νοημοσύνης συνεχίζεται ακάθεκτη. Μήπως αυτό που θα προκύψει, μόλις τα καταφέρουμε, απαιτήσει την καταστροφή της ανθρώπινης φυλής; Ο Στιούαρτ Ράσελ δηλώνει πως ακόμη τίποτε δεν έχει χαθεί· αρκεί να κατανοήσουμε πού έχουμε κάνει λάθος και μετά να το διορθώσουμε.

Ο συγγραφέας: Ο Στιούαρτ Ράσελ γεννήθηκε το 1962 στο Πόρτσμουθ της Αγγλίας. Είναι Καθηγητής Επιστήμης των Υπολογιστών και κάτοχος της Έδρας Μηχανικής Smith-Zadeh, στο Πανεπιστήμιο της Καλιφόρνιας, στο Μπέρκλεϊ των Η.Π.Α. Σπούδασε Φυσική (κάτοχος Bachelor of Arts) στο Πανεπιστήμιο της Οξφόρδης (1982) και κατόπιν ολοκλήρωσε το διδακτορικό του στην Επιστήμη των Υπολογιστών στο Πανεπιστήμιο του Στάνφορντ (1986). Στη συνέχεια, έλαβε θέση Καθηγητή (και Προέδρου) στο Τμήμα Ηλεκτρικής Μηχανολογίας και Επιστημών των Υπολογιστών του Πανεπιστημίου της Καλιφόρνιας στο Μπέρκλεϊ. Στο ίδιο πανεπιστήμιο κατέχει την Έδρα Μηχανικής Smith-Zadeh· επίσης, ίδρυσε και διευθύνει το Κέντρο για τη Συμβατή με τον Άνθρωπο Τεχνητή Νοημοσύνη (Center for Human-Compatible AI). Διετέλεσε επίκουρος Καθηγητής Νευρολογικής Χειρουργικής στο Πανεπιστήμιο της Καλιφόρνιας, στο Σαν Φρανσίσκο και Αντιπρόεδρος του Συμβουλίου του Παγκόσμιου Οικονομικού Φόρουμ για την Τεχνητή Νοημοσύνη και τη Ρομποτική.

Τιμήθηκε με τα βραβεία «Presidential Young Investigator Award» του Εθνικού Ιδρύματος Επιστημών, «Computers and Thought Award», «World Technology Award», «Mitchell» της Αμερικανικής Στατιστικής Ένωσης, «Feigenbaum» του Συνδέσμου για την Προώθηση της Τεχνητής Νοημοσύνης, και «Outstanding Educator Awards» από την ACM και την AAAI. Από το 2012 έως το 2014, ήταν κάτοχος της έδρας Chaire Blaise Pascal στο Παρίσι, ενώ του έχει απονεμηθεί η υποτροφία Andrew Carnegie Fellowship για την περίοδο 2019 έως 2021. Είναι Επίτιμος Fellow του Wadham College της Οξφόρδης, Επίτιμος Fellow του Stanford Institute for Human-Centered AI, Επίτιμος Fellow του Βασιλικού Ινστιτούτου Διεθνών Υποθέσεων (Chatham House), Fellow της Ένωσης για την Προώθηση της Τεχνητής Νοημοσύνης, του Association for Computing Machinery και της Αμερικανικής Ένωσης για την Προώθηση της Επιστήμης.

Στο έργο του Artificial Intelligence: A Modern Approach, που έχει συγγράψει με τον Peter Norvig καλύπτει ένα ευρύ φάσμα θεμάτων στον τομέα της τεχνητής νοημοσύνης που περιλαμβάνουν τη μηχανική μάθηση, την πιθανοτική συλλογιστική, την αναπαράσταση της γνώσης, τον σχεδιασμό, τη λήψη αποφάσεων σε πραγματικό χρόνο, την παρακολούθηση πολλαπλών στόχων, την υπολογιστική όραση, την υπολογιστική φυσιολογία και θέματα φιλοσοφικού περιεχομένου.

Εργάζεται επίσης για τον Οργανισμό Ηνωμένων Εθνών, αναπτύσσοντας ένα νέο παγκόσμιο σύστημα παρακολούθησης σεισμών για τη συνθήκη απαγόρευσης των πυρηνικών δοκιμών. Οι τρέχουσες ερευνητικές ανησυχίες του περιλαμβάνουν την ενδεχόμενη απειλή από τη χρήση αυτόνομων όπλων, καθώς και το μακροπρόθεσμο μέλλον της τεχνητής νοημοσύνης και τη σχέση της με την ανθρωπότητα.

Κατηγορίες:ΠΥΡΗΝΙΚΗ ΦΥΣΙΚΗ, ΡΟΜΠΟΤ, ΤΕΧΝΟΛΟΓΙΑ, ΥΠΟΛΟΓΙΣΤΕΣ

Στην θέση σας θα προσκαλούσα σε μία συζήτηση επί του θέματος τον ΚΟΡΥΦΑΙΟ έλληνα ειδικό στην πληροφορική κ τιμημένο με το βραβείο Turing κ Ιωσήφ Σηφάκη να μας διαφωτίσει επί του θέματος!

Συναδελφικά

ΓΧ

Iωσήφ Σηφάκης: Ο θαυμαστός καινούργιος κόσμος της Τεχνητής Νοημοσύνη

Eίναι μια από τις σημαντικότερες προσωπικότητες διεθνώς στον τομέα της Πληροφορικής. Αναγνωρισμένος για τις πρωτοποριακές εργασίες του στον τομέα της σχεδίασης και επαλήθευσης πληροφορικών συστημάτων, o Iωσήφ Σηφάκης τιμήθηκε με το βραβείο Τuring, αντίστοιχο του βραβείου Νομπέλ στην Πληροφορική το 2007 και το βραβείο Leonardo da Vinci το 2011. Διετέλεσε καθηγητής στο Πολυτεχνείο της Λωζάννης και ίδρυσε το περίφημο εργαστήριο Verimag (ειδικευμένο στον τομέα της σχεδίασης κρίσιμων συστημάτων) στην Γκρενόμπλ. Στο πρωτοπόρο αυτό ερευνητικό κέντρο πληροφορικής, ανέπτυξε με την ομάδα του μια σπουδαία τεχνολογία προγραμματισμού συστημάτων πλοήγησης αεροπλάνων, που συμβάλλει στην ασφάλεια και σήμερα χρησιμοποιούν όλες οι μεγάλες εταιρείες.

Θεωρείται από τους θεμελιωτές του Model-Checking που είναι η κύρια βιομηχανική μέθοδος επαλήθευσης πληροφορικών συστημάτων στην οποία βασίζουν τον τρόπο λειτουργίας τους οι κολοσσοί της πληροφορικής. Ζει σχεδόν 50 χρόνια στη Γαλλία, έρχεται συχνά στην Ελλάδα αλλά ουσιαστικά εργάζεται σε όλο τον κόσμο. Ο Ιωσήφ Σηφάκης είδε το μέλλον πολύ πριν από εμάς και τώρα ατενίζει μια νέα εποχή που ανατέλλει με τη χρήση της Τεχνητής Νοημοσύνης – με τα καλά της και τους κινδύνους της.

Υπάρχει η χιουμοριστική φράση «είναι δύσκολο να κάνεις προβλέψεις, ιδιαίτερα για το μέλλον». Είναι σίγουρο όμως ότι η τεχνολογία παίζει όλο και μεγαλύτερο ρόλο στη ζωή μας. Εσείς πώς βλέπετε τα επόμενα 10-20 χρόνια;

Είναι αναπότρεπτη η αυξανόμενη χρήση πληροφορικών συστημάτων και ιδιαίτερα Τεχνητής Νοημοσύνης για την αντιμετώπιση πλανητικών προκλήσεων όπως η κλιματική αλλαγή, πανδημίες, οικολογικές καταστροφές. Ποια θα είναι η κατανομή εργασίας μεταξύ μηχανών και ανθρώπινου παράγοντα; Σε ποιον βαθμό θα επιτρέψουμε, για λόγους αποτελεσματικότητας, στις μηχανές να αντικαταστήσουν τον άνθρωπο στη λήψη κρίσιμων αποφάσεων; Εδώ οι κίνδυνοι είναι πολλαπλοί. Η πολυπλοκότητα των συστημάτων θα ξεπεράσει κάθε δυνατότητα ορθολογιστικής κατανόησης και πρόβλεψης της συμπεριφοράς τους. Ο τεχνικός πολιτισμός στηρίχθηκε στην επιστημονική γνώση με βάση την οποία μπορούμε να εγγυηθούμε κατά τρόπο απόλυτα διαφανή και σε μεγάλο βαθμό την ασφάλεια των τεχνουργημάτων που κατασκευάζουμε. Ομως η Τεχνητή Νοημοσύνη παράγει εμπειρική γνώση της οποίας δεν μπορούμε να εκτιμήσουμε την εγκυρότητα. Επιπλέον, η συγκεντρωτική διαχείρισή της από πολυεθνικές εταιρείες που δρουν σχεδόν ανεξέλεγκτα ενέχει προφανείς κινδύνους.

Ζούμε ήδη σε μια νέα εποχή τηλεργασίας, η οποία σε χώρες όπως η Ελλάδα εντάθηκε ξαφνικά, λόγω πανδημίας. Προκαλώντας ταυτόχρονα μεγάλες αλλαγές και στον τρόπο ζωής μας. Ομως μάλλον δεν θα σταματήσουμε εκεί. Η Τεχνητή Νοημοσύνη και τα αυτόνομα συστήματα θεωρείται ότι θα αλλάξουν σε μεγάλο βαθμό την αγορά εργασίας.

Είναι βέβαιο ότι η χρήση αυτονόμων συστημάτων θα έχει επιπτώσεις στην αγορά εργασίας σε όλους τους τομείς. Φυσικά η κατασκευή και διαχείρισή τους θα απαιτήσει νέες θέσεις εργασίας υψηλής ειδίκευσης. Ομως πιστεύω ότι θα υπάρξει σοβαρός κίνδυνος ανεργίας, ιδιαίτερα στις κοινωνίες που δεν θα μπορέσουν να προσαρμοστούν στα νέα δεδομένα.

Μιλήστε μας λίγο για τα νέα όρια που εξερευνά πλέον η Τεχνητή Νοημοσύνη.

Η Τεχνητή Νοημοσύνη εξελίσσεται από «ειδική» σε «γενική». Η ειδική Τεχνητή Νοημοσύνη προσπαθεί να επιλύσει πολύπλοκα αλλά καλώς ορισμένα προβλήματα όπως να παίξεις σκάκι ή να αναγνωρίσεις αντικείμενα. Η γενική ΤΝ επιδιώκει να αντικαταστήσει τον άνθρωπο στη διεκπεραίωση δράσεων που ενέχουν τη διαχείριση πολλαπλών στόχων. Αυτό απαιτεί τη συνδυασμένη λύση προβλημάτων που επιλύουν η ειδική Τεχνητή Νοημοσύνη και οι συμβατικοί υπολογιστές. Για παράδειγμα, στα αυτόνομα αυτοκίνητα η ειδική Τεχνητή Νοημοσύνη επιτρέπει τη λύση προβλημάτων όπως η αναγνώριση εικόνας και η αποφυγή εμποδίων. Tο αυτόνομο σύστημα οδήγησης πρέπει να συνδυάζει λύσεις πολλών τέτοιων προβλημάτων για να διαχειριστεί ασφαλώς απρόβλεπτες καταστάσεις και να πλησιάσει τις ανθρώπινες ικανότητες. Λέει ο Jean Piaget ότι νοημοσύνη δεν είναι αυτό που ξέρουμε αλλά αυτό που κάνουμε όταν δεν ξέρουμε. Η πραγμάτωση του οράματος της γενικής ΤΝ θα πάρει πολλές δεκαετίες.

Αυτό τον μήνα, η Ευρωπαϊκή Επιτροπή θα προτείνει νομοθεσία για την Τεχνητή Νοημοσύνη, με προτεραιότητα, όπως αναφέρεται, για την προστασία ζητημάτων «υψηλού ρίσκου», όπως η τεχνολογία αναγνώρισης προσώπων σε δημόσιους χώρους. Ποιες πιστεύεται ότι πρέπει να είναι οι κόκκινες γραμμές;

Βλέπω δύο κινδύνους για τους οποίους επιβάλλεται να ληφθούν επειγόντως μέτρα. Ο πρώτος αφορά τις ατομικές ελευθερίες. Προέρχεται από συστήματα που παραβιάζουν την ιδιωτικότητά μας και χρησιμοποιούν προσωπικά μας δεδομένα χωρίς τη σαφή συναίνεσή μας. Να απαγορευτεί αυστηρά η εν αγνοία μας χρήση προσωπικών δεδομένων που είναι κριτήρια διακρίσεων από ιδιωτικούς ή κρατικούς φορείς π.χ. για πρόσληψη ενός υπαλλήλου ή για διαλογή υπόπτων. Χρειάζεται ένα νομοθετικό πλαίσιο το οποίο παράλληλα να προβλέπει τα μέσα ελέγχου για την τήρησή του. Δυστυχώς, δεν υπάρχουν αυστηρά και πρακτικώς εφαρμόσιμα κριτήρια για τον έλεγχο χρήσης δεδομένων.

Ο δεύτερος κίνδυνος είναι η ανεξέλεγκτη χρήση αυτονόμων συστημάτων που διεκπεραιώνουν κρίσιμες διαδικασίες όπου διακυβεύονται η ανθρώπινη και περιβαλλοντολογική ασφάλεια. Να μη θυσιάσουμε χάριν μιας αμφίβολης αποτελεσματικότητας τη δυνατότητα ελέγχου και συμμετοχής στη λήψη αποφάσεων. Χρειάζεται διαφάνεια και κατανόηση του τρόπου λειτουργίας των έξυπνων συστημάτων, πράγμα που δεν είναι εφικτό με την παρούσα κατάσταση των γνώσεών μας.

Πρόσφατα στις ΗΠΑ αποκαλύφθηκε ότι μυστικές υπηρεσίες χρησιμοποιούν παράνομα την τεχνολογία από την εταιρεία ClearView AI. Από τη στιγμή που υπάρχουν τέτοιες δυνατότητες παρακολούθησης και παρέμβασης στις ζωές των πολιτών, υπάρχει πραγματικά κάποια προστασία;

Σήμερα δεν υπάρχει προστασία και είναι τεχνικά δύσκολο να υπάρξει έλεγχος των παραβάσεων εκτός εάν ληφθούν ριζικά απαγορευτικά μέτρα. Για παράδειγμα, κάποιος μπορεί να φτιάξει το «προφίλ» σας συλλέγοντες φαινομενικά ανώδυνες πληροφορίες, εκ των οποίων ορισμένες βρίσκονται διάχυτες στο Διαδίκτυο. Πρέπει βέβαια να σας «στοχεύσει» αναλύοντας μεγάλους όγκους δεδομένων που σας αφορούν. Ετσι θα προσδιορίσει σεξουαλικές προτιμήσεις, προβλήματα υγείας, οικονομική και οικογενειακή κατάσταση, θρησκευτικές και πολιτικές πεποιθήσεις. Οι τεχνολογίες των big data δημιουργούν «συμπυκνωμένες» πληροφορίες όπως οι αποστακτήρες βγάζουν αιθέρια έλαια από τεράστιες ποσότητες πρώτης ύλης.

Πολύς λόγος έχει γίνει και για τη χρήση της Τεχνητής Νοημοσύνης στα όπλα, με ειδικούς να προειδοποιούν πως εισερχόμαστε σε έναν τομέα ιδιαίτερα επικίνδυνο που μπορεί να ξεφύγει από τον έλεγχο κάποια στιγμή. Συμμερίζεστε αυτές τις ανησυχίες;

Υπάρχει πράγματι αυτή η τάση σε όλα τα οπλικά συστήματα. Εκτός από τη γενικευμένη χρήση drones, το παράδειγμα που συζητείται και δικαίως είναι η χρήση «killer robots», ρομπότ που δρουν αυτόνομα σε πεδία μάχης. Διότι τα ρομπότ δεν έχουν συναισθήματα και αναστολές που έχει ένας στρατιώτης ακόμη και στη πιο σκληρή μάχη. Επιπλέον, ορισμένοι θεωρούν ότι καθιστούν πιο ανεκτό το «κόστος» των πολέμων σε ανθρώπινες ζωές – τουλάχιστον γι’ αυτόν που τα χρησιμοποιεί.

Ας μιλήσουμε όμως και για τις νέες δυνατότητες που μας προσφέρει αυτή η τόσο συναρπαστική «συνεργασία» του ανθρώπου με τις μηχανές, σε διάφορους τομείς.

Για επιτυχή συνεργασία χρειάζεται συνεχής ανταλλαγή πληροφοριών και συνέργεια προς το καλύτερο δυνατό αποτέλεσμα. Πρόκειται για ένα τεχνικά δύσκολο και εξαιρετικά ενδιαφέρον πρόβλημα. Για παράδειγμα στην «επιτηρουμένη αυτονομία», ένα σύστημα οδηγεί το αυτοκίνητο συνεργαζόμενο με τον οδηγό του σε δύο περιπτώσεις. Εάν ο οδηγός διαπιστώσει ότι υπάρχει κάποιος άμεσος κίνδυνος ατυχήματος, τότε παίρνει τον έλεγχο του αυτοκινήτου αποσυνδέοντας το σύστημα. Επίσης μπορεί το σύστημα να ζητήσει από τον οδηγό να πάρει τον έλεγχο διότι αδυνατεί να διαχειριστεί μια κατάσταση. Αυτού του είδους η συνεργασία κρίνεται επικίνδυνη. Πολλά ατυχήματα έγιναν επειδή η ένταση προσοχής του οδηγού μειώνεται όταν για μεγάλα χρονικά διαστήματα δεν έχει ενεργό ρόλο. Ετσι στις κρίσιμες καταστάσεις συνειδητοποιεί τον κίνδυνο πολύ αργά. Παρομοίως, όταν το σύστημα ζητήσει από τον οδηγό να επέμβει, πρέπει υπάρξουν τα κατάλληλα χρονικά περιθώρια για να κατανοήσει ο οδηγός το πρόβλημα και να αντιδράσει κατάλληλα.

Σήμερα η «συμβιωτική αυτονομία» είναι ενεργός τομέας έρευνας που μελετά τα προβλήματα αυτόνομης συνεργασίας ανθρώπου – μηχανής.

Βλέπουμε τα παιδιά να εξοικειώνονται πολύ εύκολα με την τεχνολογία, και κάποιοι επιστήμονες κάνουν λόγο για μια νέα φάση στην εξέλιξη του ανθρώπινου είδους μέσω νέων τρόπων ανάπτυξης του εγκεφάλου. Ποια είναι η δική σας θέση;

H εξέλιξη του ανθρώπου είναι συνυφασμένη με την πρόοδο της επιστήμης και της τεχνολογίας. Οι ικανότητές μας προσαρμόζονται συνεχώς σε αυτή την πρόοδο. Πριν από την ανακάλυψη της τυπογραφίας είχαμε μεγαλύτερες δυνατότητες απομνημόνευσης. Ο προϊστορικός άνθρωπος ήξερε να επιβιώνει στην άγρια φύση. Χάρη στην τεχνολογία ο άνθρωπος εξασφάλισε ποιότητα ζωής, μακροβιότητα και ανάπτυξη του πολιτισμού.

Τα έξυπνα συστήματα είναι εργαλεία που πολλαπλασιάζουν τις νοητικές μας ικανότητες. Προσοχή όμως! Οπως με τη χρήση μηχανικών συστημάτων ελευθερωθήκαμε από βαριές χειρωνακτικές εργασίες, έτσι και με τους υπολογιστές μπορούμε να διευρύνουμε τις νοητικές ικανότητες και τους ορίζοντες των γνώσεών μας. Αρκεί να εξασφαλίζουμε την εγκυρότητα των πληροφοριών τους και τη σωστή ερμηνεία τους. Ομως δεν πρέπει να μας υποκαταστήσουν σε ό,τι πιο πολύτιμο έχουμε: την ικανότητα να σταθμίζουμε καταστάσεις και να διαχειριζόμαστε επιλογές. Εάν αφήσουμε τους υπολογιστές να αποφασίζουν για μας – λόγω νωθρότητας ή έλλειψης αυτοπεποίθησης – θα εκπέσουν οι νοητικές μας ικανότητες και η δημιουργικότητα της σκέψης. Δεν θέλω να φανταστώ σενάρια όπου ένας νέος αποφασίζει για τον επαγγελματικό του προσανατολισμό στηριζόμενος αποκλειστικά σε πληροφορίες του Διαδικτύου χωρίς να λαμβάνει υπόψη του τις προτιμήσεις του και εν τέλει τα όνειρά του.

Η Ελλάδα πού βρίσκεται στον διεθνή χάρτη; Θα μπορούσε να υπάρξει κάποια πρωτοβουλία ώστε να δοθεί έμφαση στην ανάπτυξη της Τεχνητής Νοημοσύνης; Ολοι παραδέχονται την αξία των ελλήνων επιστημόνων, όμως οι ευκαιρίες που τους δίνονται στη χώρα μας δεν είναι πολλές.

Είναι ένα θέμα πολυσυζητημένο και θλιβερό. Δεν θα ήθελα να επαναλάβω τα προφανή. Εδώ και δεκαετίες πολλά θα μπορούσαμε να κάνουμε για την έρευνα και την καινοτομία, ιδιαίτερα αξιοποιώντας το ανά τον κόσμο ελληνικό επιστημονικό δυναμικό. Δυστυχώς δεν βλέπω γιατί, αφού αποτύχαμε αλλού, θα τα καταφέρουμε στην Τεχνητή Νοημοσύνη.

«Κίνδυνος αυτεξούσιας υποταγής στους υπολογιστές»

Ξοδεύονται δισεκατομμύρια για την έρευνα σε παγκόσμιο επίπεδο, αλλά ακόμα δεν γνωρίζουμε πώς διαμορφώνεται η συνειδητότητα. Φυσικά, ξέρουμε περισσότερα απ’ ό,τι παλαιότερα, όμως ακόμα έχουμε πολλά κενά.

Εχω μιλήσει για το «δικό μας Big-Bang» αναφερόμενος στην ανάδυση της συνειδητότητας μέσα από την εξέλιξη. Τονίζοντας ότι η μελέτη της είναι πιο σημαντική από τις πολυδάπανες διερευνήσεις κοσμογονικών ερωτημάτων της Φυσικής. Ελπίζω μελλοντικές έρευνες να βοηθήσουν στην κατανόησή της, να φωτίσουν τον ανεξερεύνητο εαυτό μας και να μας ανεβάσουν ψηλότερα στην κλίμακα της αυτογνωσίας.

Στο βιβλίο σας που εκδόθηκε πρόσφατα «Κατανοώντας και αλλάζοντας τον κόσμο» (εκδ. Αρμός) θέτετε σημαντικά ερωτήματα όπως η σχέση εγκεφάλου – νόησης. Τελικά μπορούν όλες οι νοητικές μας διεργασίες να κατανοηθούν μελετώντας αποκλειστικά τον εγκέφαλο;

Εάν περιοριστούμε στη μελέτη του εγκεφάλου δεν θα κατορθώσουμε να διεισδύσουμε στις νοητικές λειτουργίες. Nα το εξηγήσω με μια αναλογία; Ο νους και οι λειτουργίες του είναι ένα σύστημα όπως ο υπολογιστής σας. Είναι δυνατόν να κατανοήσω τη συμπεριφορά του υπολογιστή σας μελετώντας τα κυκλώματά του; Δηλαδή μετρώντας ηλεκτρικά σήματα, να προσδιορίσω τι ακριβώς διαδικασίες εκτελεί; Η απάντηση είναι «όχι». Αυτό οφείλεται μεταξύ άλλων στην τεράστια διαφορά των κλιμάκων αναπαράστασης της πληροφορίας στο λογισμικό και το υλικό. Μια ανάλογη διαφορά υπάρχει μεταξύ της πληροφορίας υπό μορφή ηλεκτρικών σημάτων του εγκεφάλου και της συμβολικής νοητικής πληροφορίας. Σήμερα ξέρουμε ότι τα νοήματα έχουν χαρακτηριστικά ηλεκτρικά αποτυπώματα στον εγκέφαλο. Ομως είμαστε πολύ μακριά από την επίλυση του γρίφου.

Ποιο θα είναι στο μέλλον το σημείο ισορροπίας μεταξύ της αυτονομίας των συστημάτων και του ανθρώπινου ελέγχου των λειτουργιών τους;

Εξαρτάται από τις επιλογές των ανθρώπων που πρέπει να γίνουν με γνώμονα σαφώς ορισμένα αξιακά κριτήρια. Υπάρχει εδώ και δεκαετίες μια τάση χαλάρωσης, κυρίως στις δυτικές κοινωνίες. Οι άνθρωποι αποφεύγουν την προσπάθεια και το βάρος της ευθύνης. Διαβλέπω έναν κίνδυνο αυξημένης εξάρτησης, κάποιας αυτεξούσιας υποταγής στους υπολογιστές.

Εχετε διερωτηθεί πώς θα ήταν η ζωή σας εάν είχατε έναν υπηρέτη που να ικανοποιεί κάθε σας όρεξη και επιθυμία; Να μην υπήρχαν εμπόδια, δυσκολίες, όλα να σας έρχονταν ακόπιαστα, τίποτα να μην αντιστεκόταν στις ορέξεις σας; Αν ο άνθρωπος είχε ό,τι ζητά η όρεξή του αυτόματα και χωρίς κόπο, θα υποβιβαζόταν σε μια «γαστέρα αργή», έναν πεπτικό σωλήνα. Αν είχε γεννηθεί σε έναν κόσμο χωρίς αντιξοότητες, σίγουρα δεν θα ήταν πιο έξυπνος από τα φυτά.

https://www.in.gr/2021/04/26/b-science/synenteykseis/iosif-sifakis-o-thaymastos-kainourgios-kosmos-tis-texnitis-noimosynis/